Big Data: A solução é a engenhosidade

Segundo uma publicação recente na revista HSM Management, desenhar algoritmos para tomadas de decisões com um número impensável de informações é uma grande necessidade atualmente. “Big data” é um termo que representa uma enorme quantidade de dados e um grande problema para o mundo dos negócios, pois a tomada de decisão exige uma análise de informações confiáveis e disponíveis no tempo certo.

A capacidade de armazenamento de dados dobra a cada 18 meses ou dois anos, o que não é necessariamente uma solução para o problema dos grandes dados, pois isso faz com que existam mais dados relevantes a serem analisados e menos informações úteis.

A grande questão é como transformar dados em informações úteis. O desenvolvimento do mundo representa grandes oportunidades para as empresas, mas para aproveitar isso e vencer a concorrência é necessário prever as preferências, gostos e padrões comportamentais específicos de um grupo novo, grande e diversificado de usuários principais.

Com a internet, cada pessoa passou a representar um hub que conecta pessoas, ideias, produtos, tecnologias, filosofias, comportamentos e modos de ser. São 7 bilhões de pessoas no mundo, cada uma em constante geração de dados. O estilo de vida, humores e fisiologias podem gerar dados que nos ajudam a prever comportamentos. O problema, agora, consiste em como explorar tal quantidade de informação.

A revista exemplifica o problema da grande quantidade de dados com o seguinte caso: imagine como seria analisar o padrão de relações gerado por conexões no LinkedIn para prever quem será apresentado por quem, ou o padrão de decisões de compra na Amazon das pessoas conectadas entre si pelo Facebook para prever quem são os principais influenciadores. Para solucionar essas questões há a necessidade de uma enorme quantidade de operações e não apenas uma grande capacidade de armazenamento de dados.

Ainda que o mundo dobre sua capacidade de processamento de dados a cada 24 meses, a inteligência não é suficiente para lidar com problemas que crescem mais rápido do que essa capacidade.

Isso demonstra que a necessidade atual não é a de realizar muitas operações em um curto espaço de tempo, mas sim da engenhosidade de encontrar e implantar o melhor método de soluções de problemas.

Engenhosidade é a capacidade de conceber um modo pelo qual as operações sejam sequenciadas. Trata-se de desenhar os algoritmos (sequências definidas de instruções) e a heurística (procedimento simplificador que substitui problemas mais complexos por outros de mais fácil resolução, a fim de encontrar soluções viáveis, mesmo que imperfeitas) para solucionar os grandes problemas com os grandes volumes de dados. A engenhosidade dá forma ao problema, mas também encontra formas de solucioná-lo.

A ideia básica por trás de um algoritmo de ranqueamento de páginas do Google, por exemplo, é a engenhosidade: o procedimento calcula um peso aproximado de cada página, a partir de um número relativo de links que chegam e saem – o que estimula o comportamento do usuário de navega na web -, e mede a probabilidade do usuário ficar entediado e sair da página. O algoritmo, então, constrói uma grande matriz altamente dispersa, que um banco de mainframes de 1999 pode facilmente inverter para oferecer a atualização diária da importância de cada página na web. O Google possui a patente de todos os elementos dessa engenhosidade, trazendo soluções para os problemas que os grandes volumes de dados exigem: transformar dados relevantes (comportamento do usuário e hyperlinks de cogitação) em informação útil (uma classificação de cada página) e de modo eficiente (pode-se processar essa métrica em menos de um dia).

Nossa capacidade média de solucionar problemas dobra a cada seis meses. Podemos solucionar, com a tecnologia existente, problemas maiores do que o nosso nível de capacidade de processamento individual proporcionaria, pois nós também estamos em busca de novas formas de soluções de problemas.

Ainda segundo a HSM Management, é necessário então que certas capacidades sejam cultivadas em prol da engenhosidade:

Modelagem: Entender o processamento que produz grandes dados para saber lidar com os mesmos é essencial. Sem o modelo do processo subjacente que gera os dados, não há como saber o que realmente é relevante. Porém, é necessário mais do que modelos para o fenômeno de base, também são necessários modelos para os problemas que os grandes dados alimentam.

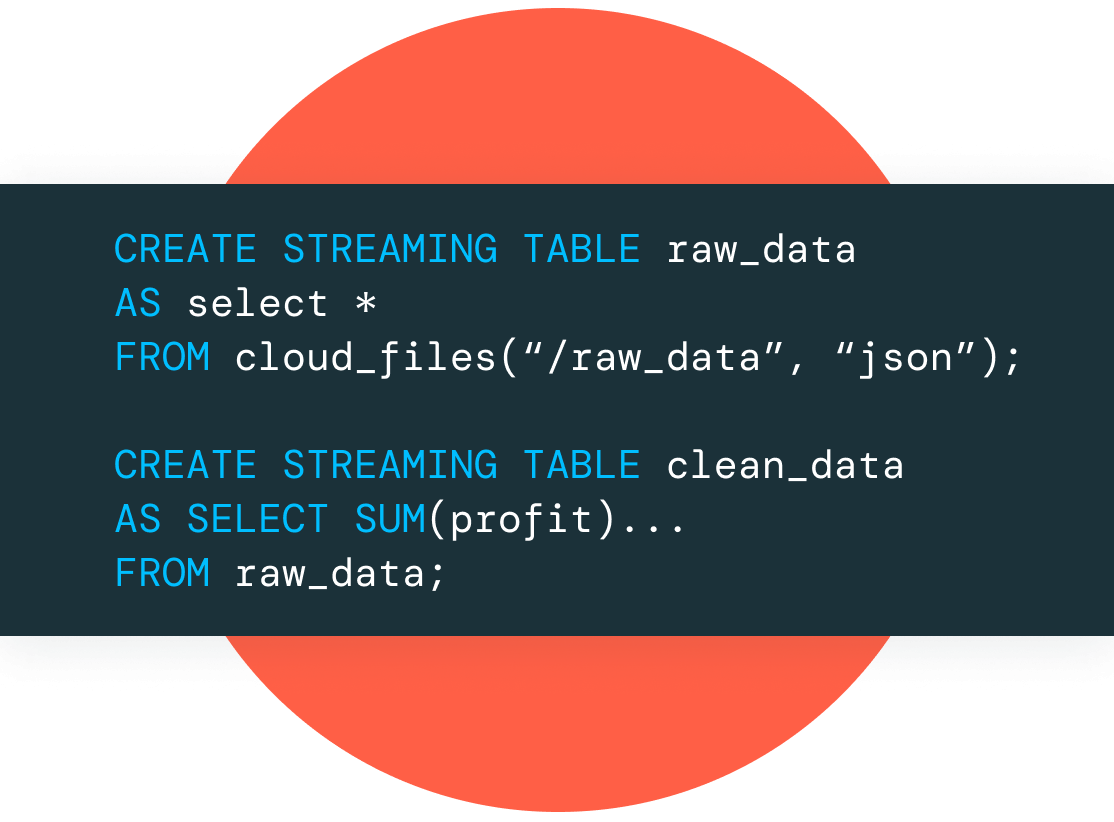

Codificação: Grande parcela dos graduados em administração desconhece as grandes massas de dados porque residem em um domínio difícil de acessar, codificadas por protocolos e linguagens estranhas.

Percepção: A informação é construída e é necessário percebê-la. A ciência da mensuração transforma qualidade em quantidade, ou seja, representa intuições, sentimentos e percepções em dados observáveis e mensuráveis. Porém, essa ciência ainda está em sua infância. A maior oportunidade para startups de internet está na construção de negócios que explorem e deem sentido aos terabytes de dados gerados por usuários do LinkeddIn, Facebook etc. Os novos mestres em Big Data serão os mestres da engenhosidade cultivada.

O software Tableau tem como diferenciais visualizações sofisticadas, relatórios e painéis com interface intuitiva de arrastar e soltar, com a qual é possível ver a mudança no momento em que elas acontecem. Qualquer um que saiba trabalhar com o Excel pode aprender a usá-lo rapidamente. Esse avançado software de business intelligence permite que todos na sua organização analisem e compreendam seus dados entre 10 a 100 vezes mais rápido do que qualquer outra solução. O download da versão trial do Tableau pode ser realizada gratuitamente no nosso site: Download do Tableau Desktop.